La Tension de Hubble

Tu lis deux rapports sur la vitesse d’expansion de l’Univers. Le premier, basé sur l’observation du fond diffus cosmologique, cette lumière fossile émise 380 000 ans après le Big Bang, annonce environ 67 kilomètres par seconde par mégaparsec. Le second, basé sur l’observation de supernovae dans des galaxies proches, annonce environ 73. Même objet, même question, deux réponses. En science, un écart pareil, quand les barres d’erreur ne se touchent pas, ce n’est pas une approximation, ce n’est pas une marge de manœuvre : c’est une tension. Et celle-ci a un nom, la tension de Hubble, et elle est au cœur des débats en cosmologie depuis plus d’une décennie. Parce que ces deux chiffres ne peuvent pas coexister si notre modèle de l’Univers est correct. Soit l’un des deux se trompe, soit il manque quelque chose à notre compréhension, un ingrédient oublié, une physique qu’on n’a pas encore vue.

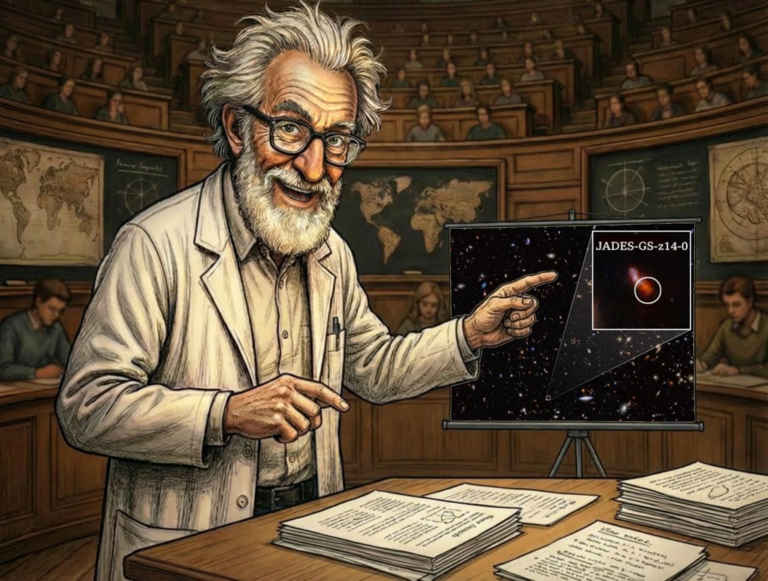

Dans Quand l’Univers change de note, on a découvert que l’espace s’étire, que la lumière s’étire avec lui, et que ce décalage vers le rouge nous permet de mesurer les distances cosmiques et de remonter le temps. Plus une galaxie est loin, plus elle semble s’éloigner vite, non pas parce qu’elle fuit à travers l’espace, mais parce que c’est l’espace lui-même qui grandit entre nous et elle. C’est la fameuse loi de Hubble-Lemaître, et elle repose sur une constante, H0, qu’on appelle la constante de Hubble. Cette constante, c’est le taux d’expansion aujourd’hui, le rythme auquel l’Univers s’étire en ce moment même. Dans Edwin Hubble, on a rencontré l’homme qui a mesuré les distances des galaxies et établi cette relation, celui dont le nom reste attaché à cette constante qui quantifie « à quelle vitesse » l’Univers grandit. Et dans Les points rouges du JWST, on a déjà croisé ces deux chiffres, 67 et 73, et cette phrase troublante : « L’Univers jeune et l’Univers proche ne racontent pas la même histoire d’expansion. » Aujourd’hui, on ouvre la boîte noire de ce désaccord. D’où viennent ces deux mesures ? Pourquoi ne tombent-elles pas d’accord ? Et surtout : quelle est la piste la plus sérieuse aujourd’hui pour les réconcilier sans casser le reste de la physique ?

La constante de Hubble, H0, c’est le taux d’expansion aujourd’hui : « de combien de kilomètres par seconde l’espace s’étire par mégaparsec de distance ». L’unité, km/s/Mpc, on l’a déjà vue dans l’article sur les points rouges du JWST : pour chaque mégaparsec de distance qui sépare deux objets, l’espace entre eux grandit d’environ 67 à 73 kilomètres chaque seconde. Plus deux galaxies sont éloignées, plus l’espace entre elles s’étire vite. Mais voilà : selon la façon dont on mesure cette constante, on ne trouve pas le même chiffre. Et ce n’est pas une petite différence qu’on pourrait attribuer à une erreur de mesure ou à une approximation. C’est un écart de 8 %, statistiquement significatif, qui résiste à toutes les vérifications.

Il y a deux grandes façons de mesurer H0, et elles ne regardent pas le même Univers. La première, c’est la méthode « locale », celle qui observe l’Univers proche, celui qu’on peut toucher du doigt, mesurer directement, étoile par étoile, galaxie par galaxie. On commence par mesurer des distances « à la main » : on utilise les parallaxes pour les étoiles proches de la Voie lactée, ces minuscules décalages apparents qu’on observe quand on regarde une étoile depuis deux points opposés de l’orbite terrestre, six mois d’intervalle. Ensuite, on grimpe l’échelle de distance cosmique en utilisant des « chandelles standard », des objets dont on connaît la luminosité intrinsèque et qui nous permettent de déduire leur distance en mesurant leur éclat apparent. Les céphéides, ces étoiles variables dont la période de pulsation est directement liée à leur luminosité, sont les premières marches de cette échelle. Puis viennent les supernovae de type Ia, ces explosions thermonucléaires d’étoiles naines blanches qui brillent toutes avec à peu près la même intensité, et qu’on peut voir jusqu’à des milliards d’années-lumière. Une fois qu’on a mesuré ces distances, on regarde le redshift de ces mêmes objets : plus c’est loin, plus le redshift est grand. En reliant distance et vitesse de récession, on déduit H0. Le projet SH0ES, mené par l’équipe d’Adam Riess, prix Nobel de physique 2011, a utilisé le télescope spatial Hubble pour mesurer plus de 320 céphéides dans des galaxies lointaines, puis a calibré les supernovae de type Ia à partir de ces distances. Résultat : H0 = 73,04 ± 1,04 km/s/Mpc, avec une précision d’environ 1 %. D’autres mesures locales, utilisant des supernovae de type II ou des observations de l’amas de Coma avec 13 supernovae Ia, vont dans le même sens, voire un peu plus haut : 76,5 ± 2,2 km/s/Mpc pour Coma. Toutes ces mesures convergent autour de 73, et le télescope James Webb a confirmé les mesures des céphéides faites par Hubble, éliminant l’hypothèse d’une erreur instrumentale systématique. La tension ne s’évapore pas : elle se renforce.

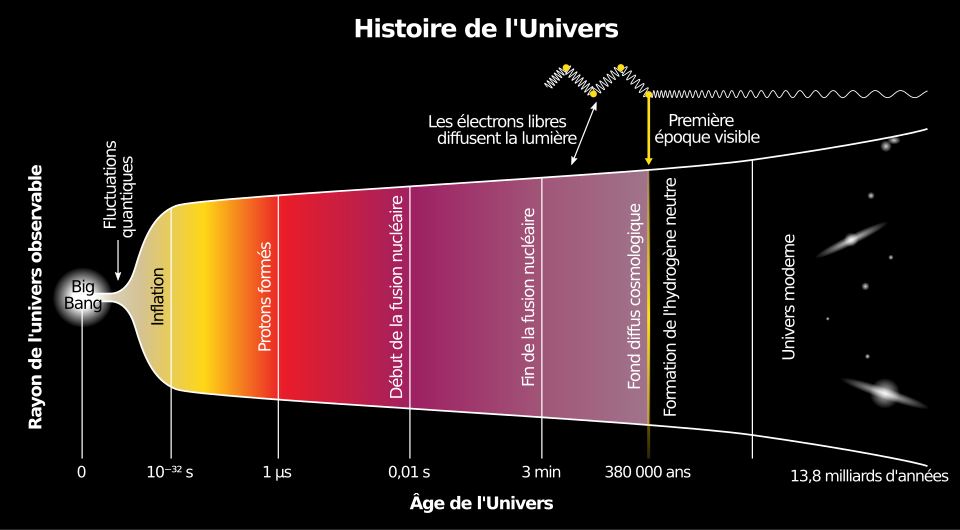

La seconde méthode, c’est la méthode « ancienne », celle qui observe l’Univers jeune, celui d’il y a plus de 13 milliards d’années, quand l’espace était mille fois plus petit et que la lumière du Big Bang venait tout juste de se libérer. On observe le fond diffus cosmologique, le CMB, cette première lumière de l’Univers émise environ 380 000 ans après le Big Bang. À cette époque, l’Univers était un plasma brûlant, opaque, où les électrons libres diffusaient la lumière dans toutes les directions comme un brouillard dense. Puis l’Univers s’est refroidi, les électrons se sont liés aux noyaux pour former des atomes neutres, et la lumière a pu enfin voyager librement. C’est ce qu’on appelle la recombinaison, et c’est le moment où l’Univers est devenu transparent. La lumière émise à cet instant précis, on la voit aujourd’hui sous forme de micro-ondes, décalée vers le rouge par 13,8 milliards d’années d’expansion cosmique. Les motifs de cette lumière, les fluctuations de température à la surface de ce « mur de feu » primordial, dépendent de la physique de l’Univers jeune et des paramètres du modèle standard de la cosmologie, le modèle ΛCDM (Lambda Cold Dark Matter), qui inclut la matière noire froide, l’énergie noire sous forme de constante cosmologique, et la matière ordinaire. En ajustant ce modèle sur les données du satellite Planck, qui a cartographié le CMB avec une précision inégalée, on déduit H0. Résultat : environ 67,4 ± 0,5 km/s/Mpc. C’est une mesure indirecte, une inférence à partir d’un modèle, mais elle est extrêmement robuste, cohérente avec d’autres observations de l’Univers ancien, et sa barre d’erreur est minuscule.

Le choc, c’est que l’écart entre les deux mesures est d’environ 8 %, et en termes de barres d’erreur, on parle d’une divergence de l’ordre de 4 à 5 sigma. En statistique, un écart de 3 sigma, c’est déjà une anomalie sérieuse. À 5 sigma, on parle de découverte. Ce n’est pas une fluctuation, ce n’est pas une approximation : c’est un désaccord franc. Soit une des deux méthodes se trompe, soit le modèle qu’on utilise pour interpréter le CMB est incomplet, soit il y a une nouvelle physique qu’on ne comprend pas encore. Et le télescope James Webb, loin de résoudre le problème, l’a aggravé. En confirmant les mesures des céphéides faites par Hubble, en éliminant l’hypothèse d’une erreur instrumentale systématique sur l’échelle de distance locale, le JWST a fermé une des portes de sortie possibles. La tension ne s’évapore pas : elle se renforce, elle résiste, elle devient une crise.

H0 ne devrait pas dépendre de la façon dont on le mesure. C’est une constante de l’Univers, une propriété globale, un chiffre unique qui décrit le taux d’expansion aujourd’hui. Si la mesure « locale » et la mesure « CMB » ne concordent pas, alors soit il y a un biais caché, une erreur systématique qu’on n’a pas encore identifiée dans la calibration des distances ou dans l’interprétation des données, soit il manque un ingrédient physique dans notre description de l’Univers, un effet oublié, une nouvelle particule, une modification de la gravité à grande échelle. Adam Riess, qui a reçu le prix Nobel pour la découverte de l’accélération de l’expansion de l’Univers, a déclaré : « Il manque quelque chose à notre compréhension de l’Univers. » Dan Scolnic, astronome à l’Université Duke, a été encore plus direct : « Notre modèle cosmologique est peut-être cassé. » Ce ne sont pas des déclarations sensationnalistes, ce sont des constats honnêtes sur la gravité du désaccord. Parce que si le modèle ΛCDM est incomplet, si notre compréhension de l’énergie noire ou de la matière noire est fausse, alors toute la cosmologie moderne repose sur des fondations fragiles.

Les pistes classiques pour résoudre cette tension sont nombreuses, et aucune ne fait consensus. Peut-être que l’énergie noire, cette force mystérieuse qui accélère l’expansion de l’Univers et qui représente environ 70 % de son contenu énergétique, ne se comporte pas comme une simple constante cosmologique. Peut-être qu’elle évolue avec le temps, qu’elle était plus faible dans le passé, qu’elle change de nature au fil de l’expansion. Peut-être que la gravité elle-même, à l’échelle cosmique, ne suit pas exactement les équations de la relativité générale, qu’il faut la modifier, l’ajuster, introduire de nouveaux termes. Peut-être qu’il y a des biais ou des erreurs systématiques qu’on n’a pas encore détectés, une sous-estimation des incertitudes, une calibration des distances qui dérive légèrement, un effet de sélection dans les échantillons de supernovae. Peut-être qu’il existe des particules exotiques, des composants inconnus de l’Univers, qui modifient l’expansion sans qu’on les ait jamais vus. Des projets comme DESI, le Dark Energy Spectroscopic Instrument, cartographient des millions de galaxies pour affiner les mesures d’expansion à différentes époques cosmiques, et peut-être qu’ils trouveront un indice, une anomalie, une signature qui pointera vers la solution. Mais pour l’instant, toutes ces pistes restent ouvertes, et aucune ne s’impose.

Parmi les pistes théoriques proposées, une fait aujourd’hui l’objet d’une attention particulière : des champs magnétiques présents dès l’Univers primordial. Une étude publiée en 2020 dans Physical Review Letters par deux cosmologistes, Karsten Jedamzik du Laboratoire Univers et Particules de Montpellier (LUPM, Université de Montpellier) et Levon Pogosian de l’Université Simon Fraser au Canada, montre que ces champs pourraient à la fois réaligner les deux mesures de H0 et expliquer l’origine du magnétisme qu’on observe dans les galaxies et entre les galaxies. C’est cette piste qu’on va détailler, non pas parce que c’est « la » solution validée, mais parce que c’est une des explications les plus sérieuses actuellement à l’étude, et qu’elle mérite d’être comprise.

La valeur de H0 qu’on tire du CMB dépend fortement de ce qu’on suppose sur l’Univers à l’époque de la recombinaison, environ 380 000 ans après le Big Bang, quand le plasma primordial devient neutre et que la lumière du CMB part dans l’espace. Tout ce qui change la physique de cette époque peut changer la valeur de H0 déduite du CMB. Et si l’Univers jeune contenait déjà de tout petits champs magnétiques, de l’ordre du nanogauss, extrêmement faibles, à peine détectables, mais présents partout ? Ces champs auraient créé des inhomogénéités de densité dans le gaz baryonique à petite échelle, des variations locales de pression, des zones où le gaz est légèrement plus dense ou plus dilué que la moyenne. Conséquence : le taux de recombinaison, la vitesse à laquelle les électrons se lient aux noyaux pour former des atomes neutres, ne serait plus exactement celui du modèle standard sans magnétisme. Les motifs du CMB en seraient modifiés, les fluctuations de température changeraient légèrement, et quand on « relit » les données en incluant cet effet, la valeur de H0 qu’on en déduit remonte et peut se rapprocher de la mesure locale. En d’autres termes : ce n’est pas que l’Univers « s’étire plus vite » aujourd’hui d’un côté que de l’autre, c’est que notre interprétation du CMB serait à corriger en ajoutant un ingrédient oublié, les champs magnétiques primordiaux.

⚛️ La recombinaison expliquée

Vers 380 000 ans après le Big Bang, l’Univers se refroidit assez pour que les électrons, qui jusqu’alors volaient librement dans un plasma brûlant, se lient aux noyaux atomiques (principalement des protons d’hydrogène et des noyaux d’hélium). Les noyaux ont une charge électrique positive, les électrons ont une charge négative, et quand ils se lient, leurs charges s’annulent : l’atome devient électriquement neutre. Ce moment, on l’appelle la recombinaison, et c’est un tournant dans l’histoire cosmique : le plasma opaque devient un gaz neutre et transparent, et la lumière peut enfin voyager librement sans être diffusée par les électrons libres. C’est cette lumière, émise à cet instant précis, qu’on observe aujourd’hui sous forme de fond diffus cosmologique.

Les champs magnétiques primordiaux modifient légèrement comment et où cette recombinaison se produit. Dans les régions où le champ magnétique est un peu plus fort, le gaz baryonique est légèrement comprimé, et la recombinaison se fait un peu plus tôt. Dans les régions où il est plus faible, elle se fait un peu plus tard. Ces variations, même infimes, laissent une empreinte sur les motifs du CMB, et c’est en lisant cette empreinte qu’on peut déduire si ces champs ont existé ou non.

Cette piste est prise au sérieux pour une raison élégante : l’intensité de champ primordial nécessaire pour réaligner H0, de l’ordre du nanogauss, fournirait une graine magnétique qui, amplifiée ensuite par effet dynamo (la rotation et la convection dans les galaxies en formation), expliquerait naturellement le magnétisme qu’on observe aujourd’hui dans les galaxies et entre les galaxies. Une seule hypothèse pourrait donc répondre à deux questions : la tension de Hubble et l’origine du magnétisme cosmique. Les auteurs soulignent que cela ouvrirait une « nouvelle fenêtre sur l’Univers primordial », une façon de sonder des processus physiques qu’on n’a jamais observés directement, qui se sont déroulés dans les premières fractions de seconde après le Big Bang, peut-être même pendant l’inflation, cette phase d’expansion exponentielle qui aurait étiré l’espace d’un facteur colossal en un temps infinitésimal. Mais il faut être honnête : c’est une piste théorique solide, revue à comité de lecture, publiée dans une revue prestigieuse, activement discutée dans la communauté, mais pas la seule en lice. On ne dit pas « le problème est résolu », on dit que c’est une des explications les plus sérieuses actuellement à l’étude, et qu’elle mérite d’être comprise par quiconque s’intéresse à la cosmologie moderne.

Deux mesures de la même constante, locale environ 73, CMB environ 67 km/s/Mpc. Un écart significatif, 4 à 5 sigma, environ 8 %, qui résiste aux vérifications. Le télescope James Webb confirme les mesures locales, élimine l’hypothèse d’une erreur instrumentale, et la tension ne s’évapore pas. La cosmologie est face à un vrai problème : soit une erreur systématique nous échappe, soit le modèle standard doit être étendu, complété, corrigé. Parmi les extensions proposées, les champs magnétiques primordiaux offrent une piste élégante : modifier la physique de la recombinaison pour réaligner le H0 du CMB avec le H0 local, tout en expliquant l’origine du magnétisme galactique. C’est aujourd’hui une des pistes les plus sérieusement discutées, même si le dernier mot reviendra aux observations et aux tests futurs.

La tension de Hubble n’est pas qu’une querelle de décimales, un désaccord technique entre deux équipes de chercheurs qui ne s’entendent pas sur la calibration de leurs instruments. C’est un signal, peut-être le signal que l’Univers peut encore nous surprendre, que des idées simples, un peu de magnétisme dès le début, peuvent éclairer des énigmes en apparence très différentes. C’est aussi un rappel que la science n’avance pas en ligne droite, qu’elle trébuche, qu’elle doute, qu’elle se remet en question, et que c’est précisément cette honnêteté, cette capacité à dire « on ne sait pas », qui fait sa force. Les projets comme DESI, les futures missions d’observation du CMB, les nouveaux relevés de supernovae, tous ces instruments continueront de sonder l’expansion de l’Univers, de mesurer H0 avec toujours plus de précision, de tester les modèles, de chercher la faille. Et peut-être qu’un jour, dans quelques années ou quelques décennies, on regardera en arrière et on se dira que la tension de Hubble était le premier indice d’une révolution en cosmologie, le premier signe que notre modèle de l’Univers devait être réécrit. Ou peut-être qu’on découvrira simplement une erreur subtile, un biais caché, et que tout rentrera dans l’ordre. Pour l’instant, on ne sait pas. Et c’est vertigineux.